深入理解内存碎片:从分段分页到池化技术

约 1381 字大约 5 分钟

2026-03-26

1. 什么是内存碎片?

在程序运行过程中,我们不断地向操作系统申请内存(malloc / new)和使用完后释放内存(free / delete)。经过频繁的“申请-释放”操作后,整个堆内存区域可能会变得“支离破碎”。

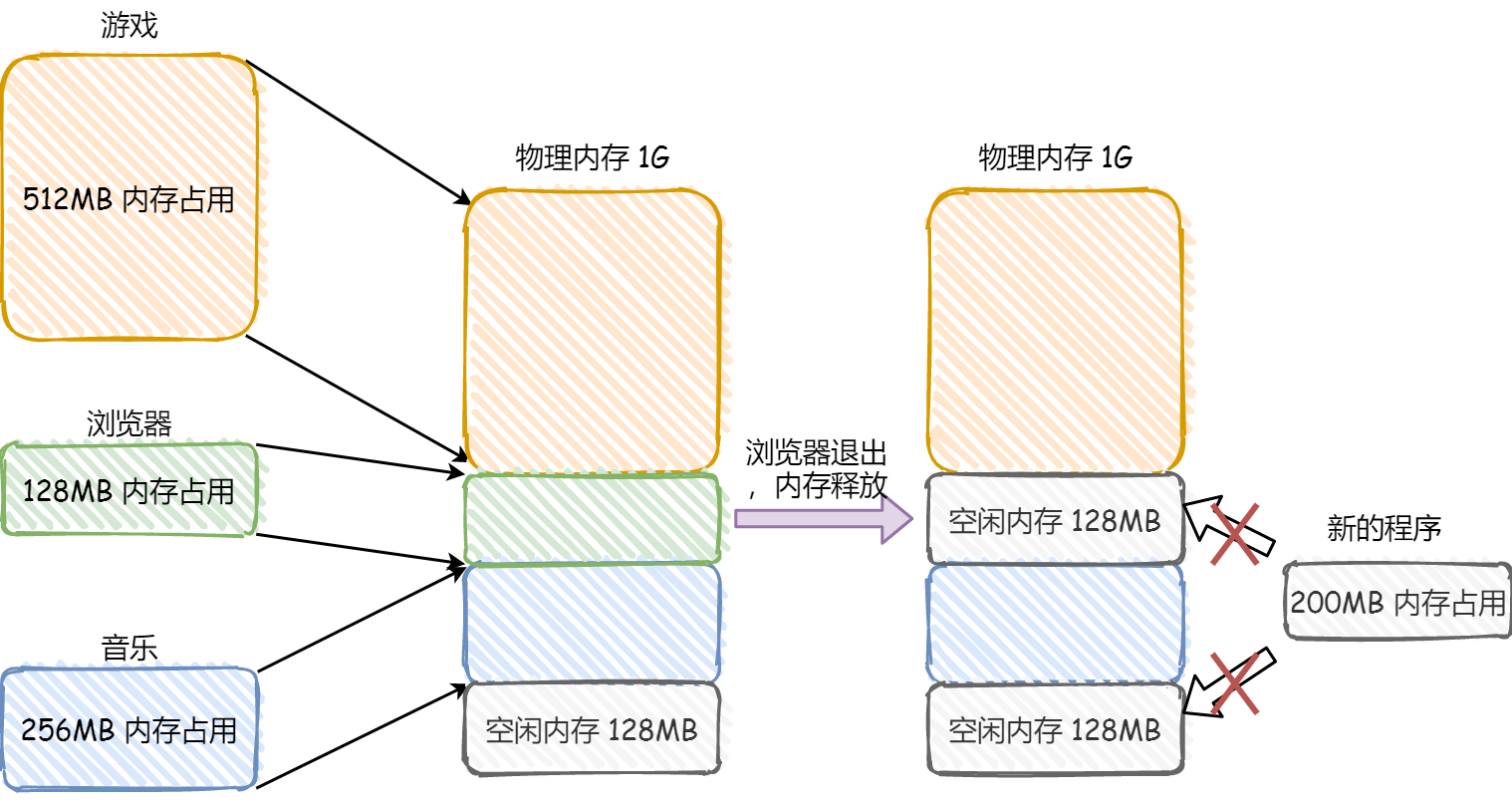

内存碎片指的是:系统中存在大量不连续的小块空闲内存,导致虽然总空闲内存足够大,但无法满足一个连续大块内存的分配请求。

2. 内部碎片 vs 外部碎片

要深入理解碎片,必须回到操作系统内存管理的两个核心机制:分段与分页。

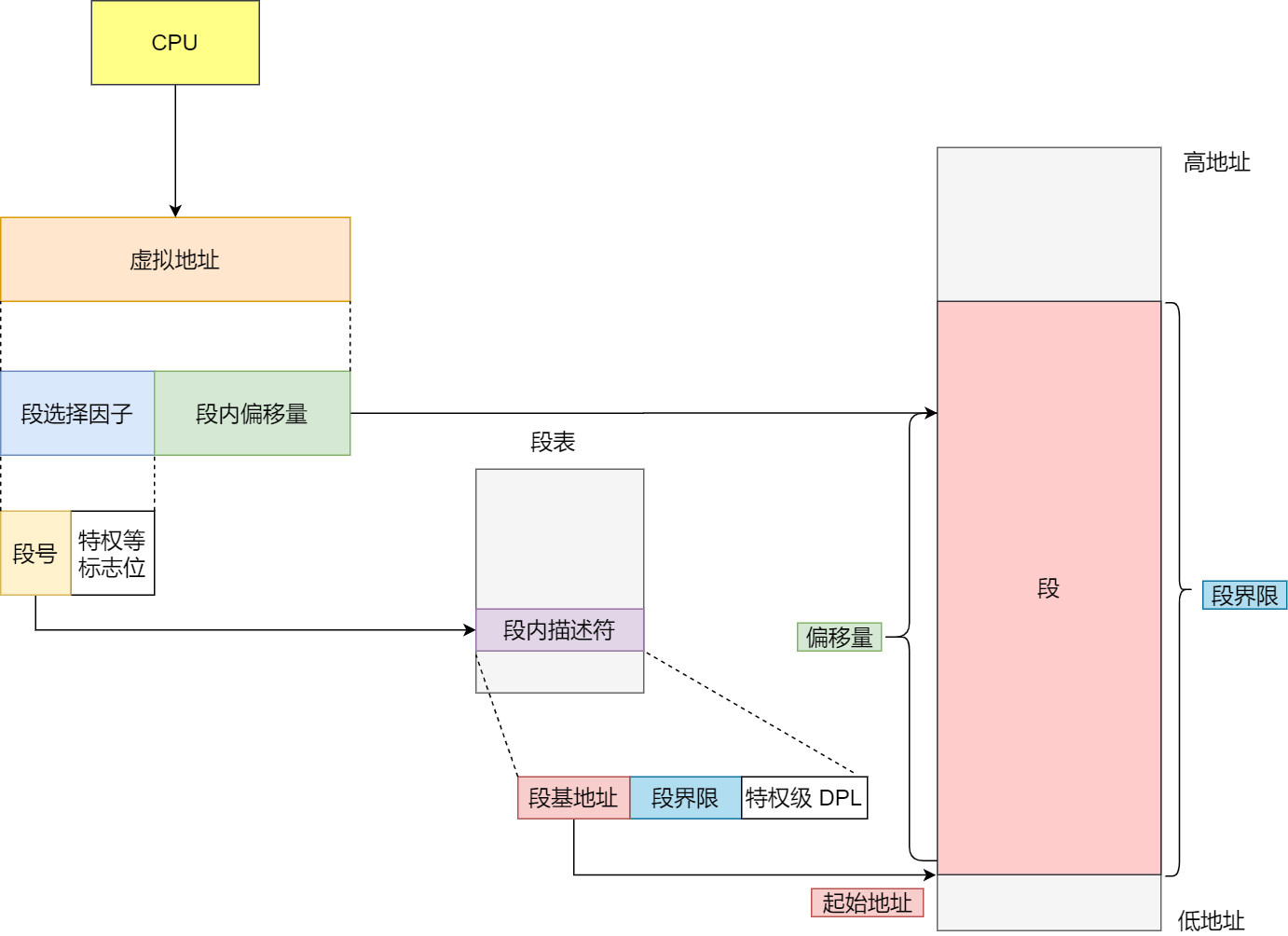

2.1 分段管理

机制:程序的内存被划分为不同的段(代码段、数据段、堆、栈等)。每个段是一个连续的内存区域。

与碎片的关系:

外部碎片:分段是导致外部碎片的主要原因。当程序不断创建和销毁不同大小的段(例如动态分配数组、结构体),内存中就会留下许多大小不一的“空洞”。随着时间推移,即使所有空闲段的总和很大,也很难找到一个大段来放置新数据。

优点:逻辑清晰,便于共享和保护。

缺点:容易产生外部碎片,需要复杂的压缩(Compaction)技术来移动已分配内存合并空闲块,但压缩耗时且需要硬件支持。

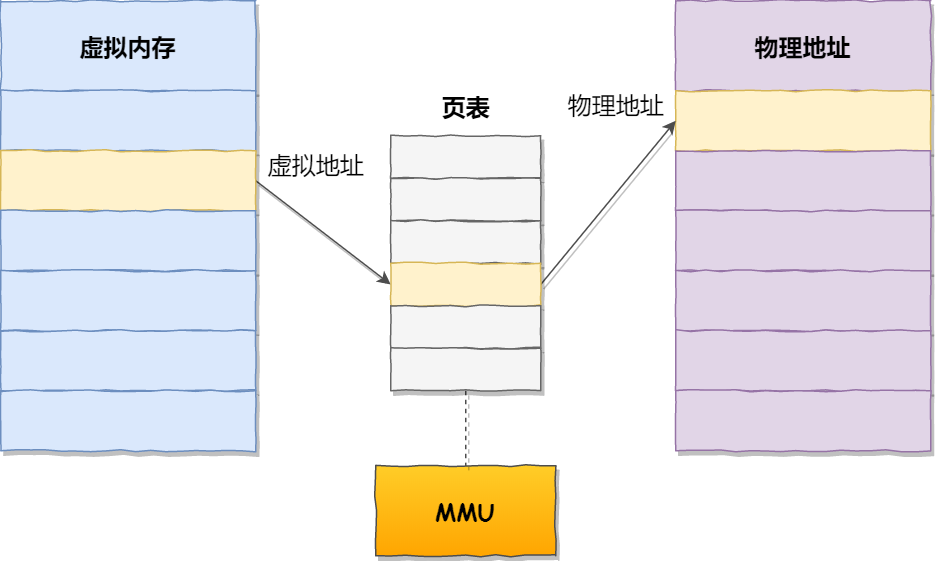

2.2 分页管理

机制:将物理内存划分为固定大小的页框(通常 4KB),将程序的逻辑地址空间划分为同样大小的页。通过页表将逻辑页映射到物理页框。

与碎片的关系:

消除了外部碎片:因为所有内存单元大小相同,任何空闲页框都可以满足任何页的请求,不存在“无法满足连续物理内存”的问题(尽管逻辑上连续,物理上可以分散)。

引入了内部碎片:如果程序申请的内存不是页面大小的整数倍,最后一个页框就会产生内部碎片。例如,申请 5KB 内存,系统会分配 2 个页框(共 8KB),浪费 3KB。

优点:消除了外部碎片,简化了内存分配。

总结

核心思想:通过将物理内存碎片化(固定大小),反而解决了逻辑上的碎片问题。

小结:分段式管理天然容易产生外部碎片;分页式管理通过固定大小的块消除了外部碎片,但带来了内部碎片。现代操作系统通常采用段页式结合(先分段,段内分页),兼顾逻辑清晰与物理高效。

3. 内存碎片如何影响程序性能?

内存分配失败:最直接的影响。程序明明检测到还有大量空闲内存,却因无法获得连续空间而崩溃(尤其在嵌入式或长时间运行的服务中)。

分配效率降低:内存分配器需要花费更多时间在空闲链表中查找合适大小的块(如首次适应、最佳适应算法),碎片越多,查找成本越高。

缓存局部性差:由于内存不连续,程序访问的数据分散在物理内存各处,导致CPU缓存命中率下降,程序运行变慢。

内存利用率低:内部碎片直接浪费了宝贵的内存资源,限制了系统能承载的并发量。

触发内存压缩或GC停顿:在某些语言(如Java的垃圾回收)或系统中,为了整理碎片,不得不暂停程序(Stop-The-World)进行内存移动和压缩,导致延迟抖动。

4. 如何避免内存碎片?

4.1 从操作系统/内存分配器层面

使用分页机制:如上述,通过固定大小的页框避免外部碎片。

智能分配算法:现代内存分配器(如 jemalloc、tcmalloc)采用slab分配或多级缓存策略。它们将内存分为大小固定的“类”(如 8B、16B、32B……),将相同大小的请求从同一池子中分配,有效减少外部碎片。

4.2 从应用层/编程实践层面

内存池化技术:这是解决碎片最有效的工程手段。

原理:一次性申请一大块内存(pool),然后由程序自己管理这块内存的分配。

优势:

减少系统调用(减少 malloc 次数)。

避免外部碎片:所有对象大小固定(或从固定大小的池中取),分配和释放只在池内进行,不会向系统返回小块内存,保持内存布局规整。

应用:游戏开发(对象池)、网络框架(连接池、内存池)、数据库(缓存池)。

合理设计数据结构:

避免频繁地 malloc 小块内存。尽量将小对象合并为大数组。

使用RAII(资源获取即初始化)或智能指针,防止内存泄漏导致空闲链表越来越长。

调整分配器行为:

在特定系统中,可以通过环境变量或编译选项调整内存分配器的对齐方式、回收阈值等。